CDN(内容分发网络)作为分布式内容加速服务,其核心优势之一便是通过弹性扩展机制,在突发流量来临时快速调配资源、分摊负载,确保服务稳定。本文将系统拆解CDN加速弹性扩展的技术原理,从流量感知、资源调度到动态适配,全方位解析其如何应对突发流量尖峰,同时探讨实际应用中的优化策略与典型案例。

一、突发流量尖峰的特点与CDN加速弹性扩展的核心目标

1. 突发流量尖峰的典型特征

突发流量尖峰并非 “匀速增长” 的常规流量,而是具有瞬时性、不可预测性、区域性、高并发四大特点,这对CDN的扩展能力提出了严苛要求:

- 瞬时性:流量在几分钟甚至几秒内从基线水平飙升至峰值,例如 “双 11” 零点的抢购请求,可能在 10 秒内使 QPS(每秒查询率)从 1 万增至 100 万;

- 不可预测性:除电商大促等计划性场景外,热点事件(如明星官宣、突发事件新闻)引发的流量尖峰难以提前精准预测,需CDN具备 “无预告” 的快速响应能力;

- 区域性:流量往往集中在特定地域,例如某场热门演唱会直播,流量主要来自粉丝集中的城市,而非全球均匀分布;

- 高并发:尖峰期的请求多为 “集中式访问”,例如同一时间段内数百万用户同时刷新商品页面、点击下载链接,对CDN节点的并发处理能力构成考验。

2. CDN弹性扩展的核心目标

面对上述特点,CDN弹性扩展需实现三大核心目标,构建 “稳、快、省” 的应对体系:

- 稳定性优先:确保流量尖峰期间不出现服务中断、内容加载失败,核心指标如 “可用性达 99.99% 以上”“请求失败率低于 0.01%”;

- 快速响应:从流量异常检测到资源扩容的全流程延迟需控制在分钟级甚至秒级,避免 “扩容赶不上流量增长” 的被动局面;

- 成本可控:弹性扩展并非 “无限制扩容”,需在满足流量需求的同时,避免资源闲置浪费,通过动态调度实现 “按需分配、用完即缩”,平衡性能与成本。

二、CDN加速弹性扩展的核心技术原理:从 “感知 - 调度 - 适配” 的闭环

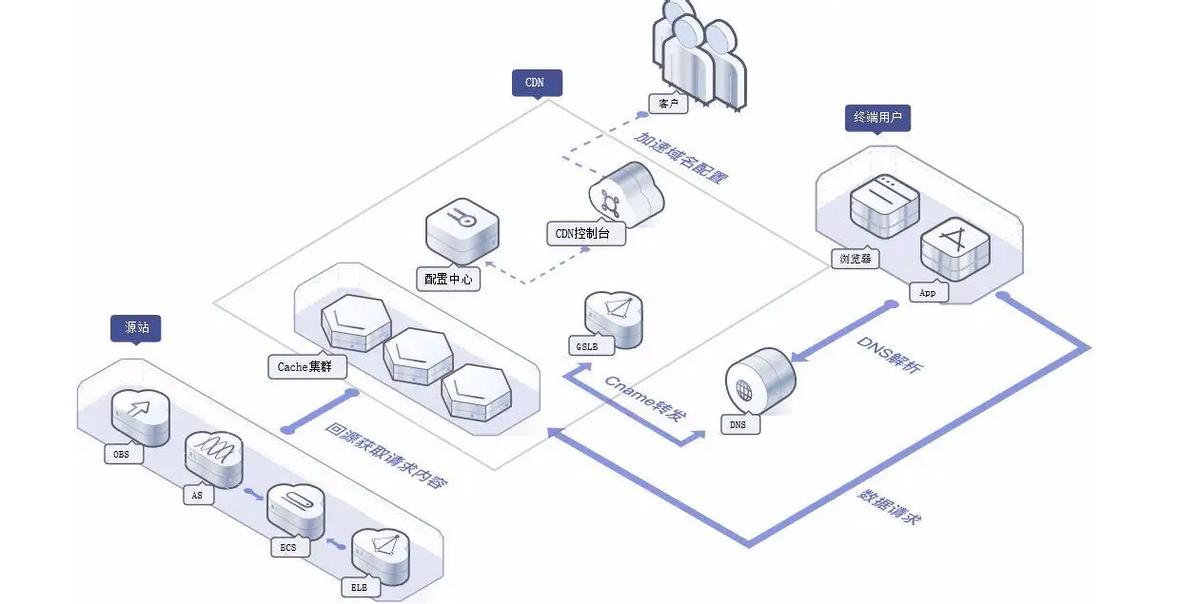

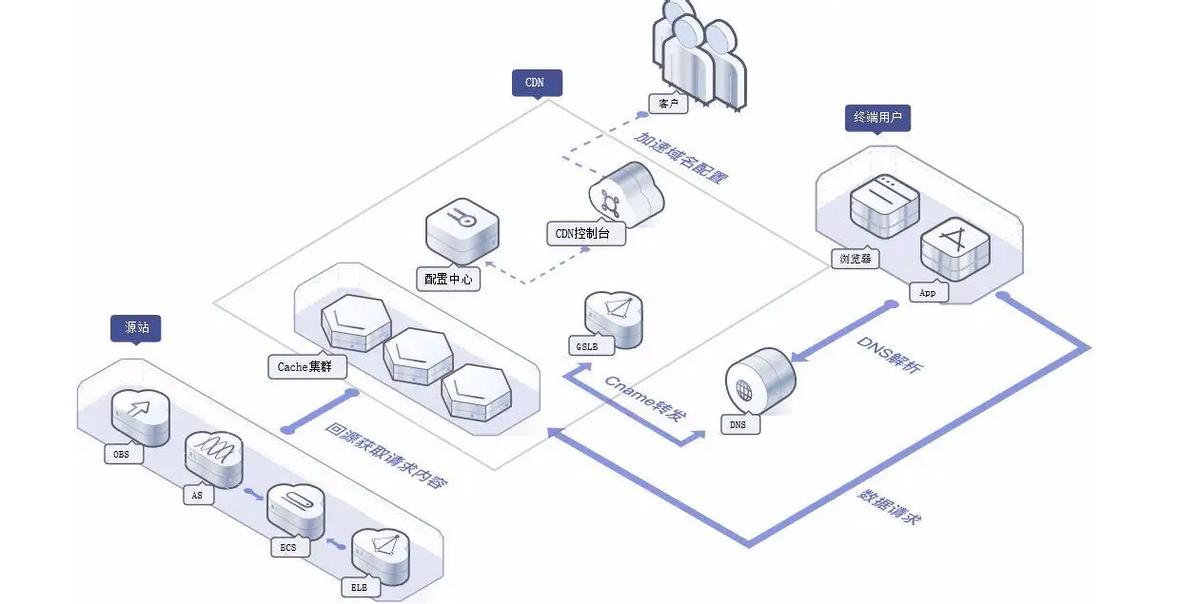

CDN应对突发流量尖峰的弹性扩展,本质是一个 **“流量感知→资源调度→节点适配→效果反馈”** 的闭环流程,依赖于分布式架构、智能算法与自动化运维的深度协同。其核心原理可拆解为三大环节:

第一环节:实时流量感知与尖峰预警 ——“提前发现信号”

应对突发流量的前提是 “及时发现异常”。CDN通过多维度流量监测体系,实时采集全网节点的访问数据,结合 AI 预测算法,实现 “异常识别 - 风险分级 - 提前预警”,为弹性扩展争取时间窗口。

1. 多维度流量监测指标

CDN的流量监测覆盖 “请求层、节点层、网络层” 三大维度,核心指标包括:

- 请求层指标:QPS(每秒查询率)、并发连接数、HTTP 状态码(如 4xx 错误率、5xx 错误率)、请求响应时间(RT);

- 节点层指标:单个CDN节点的 CPU 使用率、内存占用、磁盘 I/O、带宽利用率(如节点出口带宽是否接近上限);

- 网络层指标:节点所在区域的网络延迟、丢包率、DNS解析量(如某地域DNS查询量骤增,可能预示流量即将涌入)。

这些指标通过CDN的 “中心监控平台” 实时汇总,例如阿里云CDN的 “云监控” 系统、腾讯云CDN的 “流量分析” 模块,可实现秒级数据采集与可视化展示(如实时折线图、地域热力图),让运维人员直观掌握流量变化趋势。

2. AI 驱动的尖峰预警算法

仅靠 “实时监测” 不足以应对不可预测的流量尖峰,CDN还需通过预测算法提前预判风险,常见策略包括:

- 历史数据对比法:基于历史同期数据(如去年 “双 11” 同一时段的流量曲线)、近期基线数据(如过去 7 天的平均流量),设定 “异常阈值”—— 当实时流量超过基线的 3 倍(或自定义阈值)时,触发预警;

- 机器学习预测模型:利用 LSTM(长短期记忆网络)、ARIMA(自回归积分移动平均模型)等算法,结合业务场景特征(如大促活动周期、热点事件热度),对未来 10 分钟 - 1 小时的流量趋势进行预测。例如,在电商大促前,模型可根据预售期的流量增长斜率,预测正式开售后的峰值流量,并提前 20 分钟发出 “扩容建议”;

- 事件触发式预警:针对计划性场景(如直播预告、大促活动),CDN支持 “手动触发预警”—— 业务方提前配置 “事件时间窗”(如 “11 月 11 日 00:00-02:00 为高流量时段”),系统在时间窗开启前自动进入 “预警状态”,启动资源预热。

通过上述机制,CDN可实现 “提前 5-30 分钟发现流量尖峰信号”,为后续的弹性扩展争取关键时间。

第二环节:资源动态调度与弹性扩容 ——“快速调配兵力”

当流量尖峰被感知或预警后,CDN进入核心的 “弹性扩展” 阶段,通过分布式资源池调度与多维度扩容手段,将流量分摊至更多节点,避免单点过载。这一环节的核心是 “快” 与 “准”—— 快速调动资源,精准匹配流量需求。

1. CDN弹性扩展的资源基础:分布式节点池与云原生架构

CDN的弹性扩展能力,依赖于两大基础架构:

- 全球分布式节点池:主流CDN服务商(如 Cloudflare、阿里云CDN、Akamai)在全球部署数十万甚至上百万个边缘节点,这些节点按地域、运营商划分成多个 “资源池”(如 “中国华东电信池”“北美 AWS 节点池”)。每个资源池具备独立的计算、存储与带宽资源,可通过中心调度平台统一管理,为弹性扩展提供 “可调用的兵力储备”;

- 云原生弹性架构:现代CDN普遍采用 “云原生 + 容器化” 部署 —— 边缘节点的服务(如缓存服务、负载均衡服务)通过 Docker 容器运行,节点资源(CPU、内存、带宽)与云服务商(如 AWS、阿里云 ECS)的弹性计算资源打通。当自有节点池资源不足时,可快速调用云厂商的弹性云服务器(ECS)、弹性带宽,临时扩容节点能力,实现 “云 - 边协同” 的弹性扩展。

2. 三大核心扩容手段:从 “节点调度” 到 “资源补位”

针对不同类型的突发流量(如区域性流量、全局流量、特定内容流量),CDN采用三种差异化的弹性扩容手段,确保资源精准匹配:

手段 1:边缘节点动态调度 ——“就近分流,避免拥堵”

当某一地域出现流量尖峰时(如某城市举办演唱会,当地用户集中访问直播页面),CDN通过DNS智能解析与节点负载均衡,将流量分散至周边空闲节点,避免单一区域节点过载:

- DNS层面调度:CDN的DNS服务器实时监测各节点的负载状态(如 CPU 使用率、带宽占用),当发现 “上海电信节点” 负载超过 80% 时,自动将后续上海电信用户的DNS解析请求,导向 “杭州电信节点”“南京电信节点” 等负载较低的周边节点,实现 “就近访问 + 负载分摊”;

- 节点层面调度:若单一节点内的某类资源(如视频缓存)访问量骤增,节点内部会启动 “本地负载均衡”—— 将请求分配至不同的缓存服务器(如同一节点内的 10 台缓存机,按轮询或加权方式分配请求),避免单台服务器过载。

例如,2022 年卡塔尔世界杯期间,某直播平台的CDN通过DNS调度,将北京、上海等热门城市的直播流量,分流至天津、苏州、无锡等周边节点,使单节点最大负载从 90% 降至 60%,直播卡顿率下降 70%。

手段 2:缓存资源弹性扩容 ——“预存内容,减少回源”

突发流量尖峰中,大量重复请求(如同一商品图片、同一视频片段)若频繁回源(访问源服务器),会导致源站压力骤增。CDN通过缓存资源弹性扩容,提前增加热门内容的缓存副本数量,减少回源流量,同时提升访问速度:

- 缓存预热:在可预测的流量尖峰前(如大促开始前 2 小时),CDN根据历史数据或业务方提供的 “热门内容清单”(如 TOP1000 商品图片、直播视频封面),主动从源站拉取内容,存储到更多边缘节点的缓存中。例如,“双 11” 前,电商平台会将首页 Banner 图、热门商品详情页的静态资源,提前预热到全国 80% 以上的CDN节点,使尖峰期的回源率从 30% 降至 5% 以下;

- 动态缓存策略调整:针对突发热门内容(如某条突然走红的短视频),CDN通过实时监测 “内容访问频次”,自动将 “访问频次超过 1000 次 / 分钟” 的内容,标记为 “热门内容”,并触发 “缓存副本扩容”—— 将该内容同步至更多同地域或跨地域节点,同时延长缓存过期时间(TTL),避免频繁失效。

手段 3:云资源弹性补位 ——“按需调用,应对超预期流量”

当CDN自有节点池的资源无法满足超预期流量时(如突发热点事件导致全网流量增长 50 倍),CDN会调用云厂商的弹性计算与存储资源,临时搭建 “弹性边缘节点”,实现资源的无上限扩展:

- 弹性计算资源调用:CDN与云服务商(如 AWS EC2、阿里云 ECS)打通 API 接口,当自有节点负载超过阈值时,自动触发云服务器扩容 —— 在几分钟内创建数百台甚至数千台云服务器,部署CDN缓存服务,作为 “临时边缘节点” 接入CDN网络;

- 弹性带宽扩展:除计算资源外,CDN还可向运营商或云厂商申请 “临时弹性带宽”,例如某节点的默认出口带宽为 10Gbps,尖峰期可临时扩展至 50Gbps,避免带宽瓶颈导致的访问卡顿;

- Serverless 架构应用:部分CDN采用 Serverless(无服务器)架构,将内容处理任务(如图片压缩、视频转码)部署在云厂商的 Serverless 平台(如 AWS Lambda、阿里云函数计算),无需提前预留资源,按实际调用量付费。当突发流量来临时,Serverless 平台自动扩容处理能力,处理完后自动释放资源,实现 “零闲置成本”。

3. 扩容优先级与资源回收机制 ——“按需分配,用完即缩”

CDN的弹性扩展并非 “无限制扩容”,而是基于优先级策略与资源回收机制,平衡性能与成本:

- 扩容优先级:根据业务类型与流量紧急程度,设定扩容优先级 —— 例如,电商平台的 “支付页面”“订单页面” 优先级高于 “商品评论页面”,直播平台的 “直播流传输” 优先级高于 “弹幕互动”。扩容时优先保障高优先级业务的资源需求;

- 资源回收:当流量尖峰过后(如大促结束、热点事件降温),CDN通过实时监测发现节点负载降至阈值以下(如 CPU 使用率低于 40%),会自动启动 “资源回收流程”—— 先关闭临时调用的云服务器与弹性带宽,再将缓存中的非热门内容逐步清理(按 LRU 算法,即 “最近最少使用” 原则),释放存储资源,避免资源闲置浪费。

例如,某电商平台 “双 11” 结束后 1 小时内,CDN自动回收了 90% 的临时云服务器资源,使资源成本降低 85%,同时保留核心节点的缓存资源,应对后续的 “退货潮” 小流量高峰。

第三环节:传输与协议层适配 ——“优化通道,提升效率”

在资源扩容的同时,CDN还需通过传输协议优化与内容压缩技术,提升单节点的流量处理效率,让有限的资源承载更多请求,进一步增强弹性扩展的效果。

1. 高效传输协议:从 HTTP/1.1 到 HTTP/3

传统 HTTP/1.1 协议存在 “连接复用差、头部冗余大” 等问题,在高并发场景下效率较低。CDN通过采用HTTP/2、HTTP/3(QUIC 协议) ,提升传输效率,间接提升节点的抗流量能力:

- HTTP/2 的多路复用:允许在同一 TCP 连接中传输多个请求,避免 HTTP/1.1 的 “队头阻塞” 问题,使单连接的请求处理效率提升 3-5 倍;

- HTTP/3 的 QUIC 协议:基于 UDP 协议实现,支持 “0-RTT 连接建立”(首次连接延迟降低 50%)、“连接迁移”(用户切换网络时无需重新建立连接),同时具备更强的抗丢包能力,在弱网络环境下(如 4G/5G 移动网络)的传输效率提升 40% 以上。

例如,某短视频平台在CDN中全面启用 HTTP/3 后,突发流量尖峰期的视频加载成功率从 88% 提升至 99.5%,平均加载时间从 2.5 秒缩短至 0.8 秒。

2. 内容压缩与格式优化 ——“减小体积,加速传输”

通过对传输内容进行压缩与格式优化,减少数据传输量,可在不增加带宽资源的情况下,提升单位时间内的请求处理能力:

- 静态资源压缩:对 HTML、CSS、JavaScript 文件采用 Gzip 或 Brotli 压缩算法,压缩率可达 60%-80%;对图片采用 WebP、AVIF 等高效格式,在保证画质的同时,文件体积比 JPEG 小 30%-50%;

- 动态内容压缩:对动态生成的内容(如用户个性化推荐页面),采用 “动态 Gzip 压缩”,实时压缩后再传输,减少传输带宽占用;

- 视频自适应码率:针对视频内容,根据用户的网络状况(如 4G/5G/Wi-Fi),自动调整视频码率(如高清、标清、流畅),避免高码率视频在弱网络下的卡顿,同时减少整体带宽消耗。

三、CDN加速弹性扩展的关键技术组件:支撑机制落地的 “硬核实力”

CDN弹性扩展机制的落地,依赖于四大关键技术组件的协同工作,这些组件构成了 “感知 - 调度 - 适配” 闭环的技术基石。

1. 中心调度平台:弹性扩展的 “指挥中枢”

中心调度平台是CDN弹性扩展的核心大脑,负责全网节点的监控、决策与调度,具备三大核心能力:

- 实时数据汇聚:通过 SDK、API 等方式,实时采集全球边缘节点的流量数据、负载数据、网络数据,每秒处理数百万条数据记录,并存储到分布式数据库(如 HBase、InfluxDB)中;

- 智能决策算法:基于采集到的数据,运行流量预测、负载分析、扩容决策等算法,生成 “扩容方案”(如 “上海电信节点需扩容 50 台云服务器”“北京地区需预热 1000 个热门商品资源”);

- 自动化执行:将决策结果转化为自动化操作指令(如调用云厂商 API 创建 EC2 实例、向边缘节点发送缓存预热命令),无需人工干预,实现 “分钟级扩容”。

例如,Cloudflare 的 “Global Network” 中心调度平台,可在 20 秒内完成 “流量异常检测 - 扩容决策 - 指令下发” 的全流程,支撑全球 275 个城市的节点弹性扩展。

2. 边缘计算节点:弹性扩展的 “执行单元”

边缘节点是CDN与用户直接交互的 “前线阵地”,其弹性能力直接决定了流量处理效率。现代CDN边缘节点具备两大特性:

- 容器化部署:节点的核心服务(如 Nginx 缓存服务、Varnish 缓存服务)通过 Docker 容器运行,容器化使节点服务的启动时间从 “小时级” 缩短至 “秒级”,同时支持快速复制与迁移 —— 当需要扩容时,可在几分钟内启动数百个缓存容器,部署到不同节点;

- 轻量化设计:边缘节点采用 “轻量化操作系统”(如 Linux 精简版)与 “模块化服务架构”,仅保留核心的缓存、负载均衡、压缩等功能,减少资源占用。例如,某CDN的边缘节点单个缓存容器仅占用 50MB 内存,比传统虚拟机部署节省 70% 资源,可在单台物理机上部署更多容器,提升节点的资源密度。

此外,边缘节点还支持 “动态扩容插件”—— 当检测到特定类型流量激增(如视频请求、下载请求)时,自动加载对应的优化插件(如视频分片传输插件、P2P 加速插件),进一步提升流量处理能力。例如,某下载平台的CDN节点,在突发下载流量来临时,自动加载 “多线程下载插件”,将单用户的下载并发数从 4 线程提升至 16 线程,下载速度提升 3 倍,同时降低节点的并发连接压力。

3. 智能DNS系统:弹性扩展的 “流量导航仪”

智能DNS系统是CDN实现 “就近分流” 与 “负载均衡” 的核心组件,其核心功能是根据用户的地域、运营商、节点负载状态,将DNS解析请求导向最优节点,避免流量集中到过载节点。现代CDN的智能DNS系统具备三大能力:

- 实时负载感知解析:DNS服务器与中心调度平台实时同步各节点的负载数据(如 CPU 使用率、带宽占用),当某节点负载超过阈值时,自动将该节点从DNS解析列表中临时移除,不再将新用户导向该节点;待节点负载降至正常水平后,重新加入解析列表。例如,当 “广州联通节点” 负载达到 85% 时,DNS系统自动停止向该节点分配新请求,将广州联通用户的解析请求导向 “深圳联通节点”“东莞联通节点”,实现动态分流。

- 多维度解析策略:除负载因素外,DNS系统还支持根据 “用户网络质量”“内容缓存位置” 等维度优化解析结果:

- 网络质量优先:通过 ICMP ping、TCP 握手延迟检测等方式,测试用户到各节点的网络延迟与丢包率,将用户导向延迟最低(如延迟 < 50ms)、丢包率最低(如丢包率 < 1%)的节点;

- 内容缓存优先:若用户请求的内容已缓存到某节点,DNS系统会优先将用户解析到该节点,避免回源请求。例如,用户请求某热门短视频,DNS检测到 “成都电信节点” 已缓存该视频,即使 “重庆电信节点” 负载更低,仍优先将用户解析到成都电信节点,减少回源流量。

- 抗 DDoS 攻击能力:智能DNS系统还具备 “抗攻击解析” 功能,当某节点遭受 DDoS 攻击(如流量型攻击、请求型攻击)时,DNS系统可快速识别攻击流量,并将正常用户请求导向其他节点,同时将攻击流量引流至 “清洗中心” 过滤,确保弹性扩展过程不受攻击干扰。例如,某游戏CDN的DNS系统,在检测到 “北京移动节点” 遭受 100Gbps DDoS 攻击时,5 秒内完成攻击识别,将北京移动用户的正常请求导向 “天津移动节点”“石家庄移动节点”,同时将攻击流量引流至抗 DDoS 清洗中心,保障游戏服务正常运行。

4. 分布式缓存系统:弹性扩展的 “内容仓库”

分布式缓存系统是CDN存储热门内容、减少回源的核心组件,其弹性能力直接决定了CDN应对 “重复请求型流量尖峰” 的效率。现代CDN的分布式缓存系统采用 “多级缓存架构” 与 “动态缓存策略”,实现缓存资源的弹性扩展:

- 多级缓存架构:缓存系统分为 “边缘节点缓存→区域中心缓存→源站缓存” 三级:

- 边缘节点缓存:存储访问频次最高的内容(如近 10 分钟内访问超过 500 次的内容),直接面向用户提供服务;

- 区域中心缓存:存储区域内热门内容(如近 1 小时内区域内访问超过 1000 次的内容),当边缘节点未缓存某内容时,先从区域中心缓存获取,避免直接回源;

- 源站缓存:存储源站的全量内容,作为最终备份。

这种多级架构可实现 “缓存资源的弹性分层扩展”—— 当某区域出现流量尖峰时,优先扩展边缘节点缓存(增加缓存副本数量);若边缘节点缓存容量不足,再扩展区域中心缓存的存储资源,形成 “层层递进” 的缓存扩容体系,减少回源压力。例如,某新闻平台在突发热点事件时,区域中心缓存的存储容量从 10TB 临时扩展至 50TB,存储更多热点新闻图片与视频,使边缘节点的回源率从 15% 降至 3%。

- 动态缓存淘汰与预热策略:缓存系统采用 “智能缓存淘汰算法” 与 “动态预热机制”,优化缓存资源利用率:

- LRU - K 淘汰算法:相比传统的 LRU 算法(仅考虑最近使用时间),LRU - K 算法结合 “最近 K 次访问时间” 与 “访问频次” 综合判断内容的热度,避免误淘汰仍有潜在访问需求的内容。例如,某电商平台的CDN缓存系统采用 LRU - 3 算法,仅淘汰 “最近 3 次访问时间最早且访问频次低于 10 次 / 小时” 的内容,确保热门商品缓存不被误删;

- 实时预热触发:当检测到某内容的访问频次在 5 分钟内增长 10 倍(如某条微博突然走红),缓存系统自动触发 “实时预热”—— 从源站拉取该内容,同步至该地域的所有边缘节点与区域中心缓存,无需等待用户请求触发缓存,实现 “未求先存”。

四、CDN弹性扩展的实际优化策略:从 “能用” 到 “好用”

在实际应用中,CDN弹性扩展机制并非 “开箱即用”,需结合业务场景进行针对性优化,才能达到 “最佳性价比”。以下是五大关键优化策略:

1. 基于业务场景的扩容阈值定制

不同业务的 “正常流量基线” 与 “峰值容忍度” 差异极大,需避免采用 “一刀切” 的扩容阈值(如统一设定 “负载超过 80% 触发扩容”)。正确的做法是:

- 按业务类型划分阈值:

- 核心业务(如支付、直播流):设定较低的扩容阈值(如负载超过 60% 触发扩容),预留更多资源冗余,确保零风险;

- 非核心业务(如评论、历史数据查询):设定较高的扩容阈值(如负载超过 90% 触发扩容),充分利用现有资源,降低成本。

- 按流量类型调整阈值:

- 静态资源请求(图片、CSS):节点处理效率高,扩容阈值可设为 85%;

- 动态资源请求(API 接口、个性化页面):节点处理复杂度高,扩容阈值可设为 70%,避免 CPU 过载导致响应延迟。

例如,某电商平台将 “支付页面” 的扩容阈值设为 60%,“商品评论页面” 的阈值设为 90%,在 “双 11” 期间,既保障了支付业务的稳定,又减少了非核心业务的扩容成本,整体资源利用率提升 25%。

2. 预热内容的精准筛选

缓存预热是应对计划性流量尖峰的关键,但盲目预热会导致 “无效缓存占用资源”(如预热的内容在尖峰期访问量低)。优化策略包括:

- 基于历史数据的热门内容预测:分析过往同期(如去年 “618”)的热门内容清单,结合当前预售数据、搜索数据,筛选出 “预测访问量前 10%” 的内容进行预热,避免全量预热;

- 分优先级预热:将预热内容分为 “核心内容”(如首页、TOP100 商品)与 “普通内容”(如 TOP101 - 1000 商品),核心内容提前 48 小时预热,普通内容提前 24 小时预热,平衡预热效果与资源消耗;

- 预热效果验证:预热完成后,通过 “模拟请求” 测试边缘节点的缓存命中率,若某内容的缓存命中率低于 80%,重新触发预热,确保预热有效性。

某直播平台通过精准筛选,将预热内容从 10 万条减少至 1 万条,预热时间从 12 小时缩短至 2 小时,同时缓存命中率保持在 95% 以上,节省 60% 的预热带宽资源。

3. 云资源与自有资源的协同调度

CDN的弹性扩展需平衡 “自有节点资源” 与 “云资源” 的使用比例,避免过度依赖云资源导致成本过高。优化策略包括:

- 资源优先级调度:优先使用自有节点资源承载流量,仅当自有节点负载超过 80% 时,再调用云资源;

- 云资源按需选择:根据流量持续时间选择云资源类型:

- 短期流量(如 1 小时内的热点事件):选择按分钟计费的弹性云服务器(如 AWS EC2 Spot 实例),成本比按需实例低 50%;

- 长期流量(如 3 天以上的大促):选择预留实例或 Savings Plans,成本比按需实例低 30%-40%;

- 资源回收触发条件优化:当自有节点负载降至 60% 以下,且云资源已连续 30 分钟处于低负载状态(CPU 使用率 < 30%)时,再逐步回收云资源,避免频繁切换导致的资源波动。

某CDN服务商通过上述策略,在 “双 11” 期间将云资源的使用比例从 50% 降至 25%,整体资源成本降低 40%,同时未影响服务稳定性。

4. 流量限流与降级的精细化配置

在极端流量场景下(如流量超过预期 50% 以上),仅靠扩容可能无法完全应对,需通过 “限流” 与 “降级” 保障核心业务正常运行。优化策略包括:

- 分层次限流:

- 入口限流:在CDN边缘节点对非核心业务请求实施限流(如限制评论图片的请求 QPS 不超过总 QPS 的 10%),优先保障核心业务(如支付、直播流)的请求处理;

- 用户分级限流:对普通用户实施基础限流(如单用户每分钟最多发起 50 次请求),对 VIP 用户放宽限制(如单用户每分钟最多发起 200 次请求),平衡用户体验与系统稳定性;

- 柔性降级而非硬性拒绝:对触发限流的请求,避免直接返回 “403 错误”,而是采用 “柔性处理”:

- 静态资源请求:返回低清晰度版本(如图片从 4K 降至 1080P),或提示 “当前访问人数较多,建议稍后重试”;

- 动态资源请求:返回缓存的历史数据(如 5 分钟前的商品价格),而非实时数据,减少后端服务压力。

例如,某社交平台在突发热点事件中,对普通用户的 “历史照片查询” 请求实施限流,返回 “当前访问繁忙,为您展示最近 1 小时的照片”,同时保障 “实时消息发送”“官宣内容访问” 等核心功能不受影响,用户投诉率仅上升 0.5%,远低于硬性限流时的 10%。

5. 全链路监控与复盘优化

CDN弹性扩展的效果需通过 “全链路监控” 评估,并通过 “复盘优化” 持续迭代。优化策略包括:

- 全链路指标监控:除监控CDN节点的负载、带宽、请求成功率外,还需监控 “端到端” 指标(如用户端的页面加载时间、视频卡顿率、DNS解析延迟),以及 “上下游链路” 指标(如源站的回源流量、数据库的查询压力),确保弹性扩展不仅解决CDN层面的问题,还能缓解整个业务链路的压力;

- 尖峰后复盘分析:流量尖峰结束后,开展 “复盘会议”,分析:

- 弹性扩展的响应速度是否达标(如从预警到扩容完成的时间是否在预期内);

- 扩容资源是否过剩或不足(如某区域的云资源使用率仅 40%,说明扩容过度;某区域的节点仍出现过载,说明扩容不足);

- 限流与降级策略是否合理(如是否因限流导致核心用户体验下降);

- 策略迭代优化:根据复盘结论,调整弹性扩展策略,如优化扩容阈值、更新缓存预热清单、调整限流规则,为下一次流量尖峰做好准备。

某电商平台在 “双 11” 后,通过复盘发现 “华东地区的云资源使用率仅 35%,存在过度扩容”,于是调整该区域的扩容策略,将云资源申请数量从 2000 台降至 1200 台,同时优化DNS调度算法,将更多流量导向自有节点,在后续的 “双 12” 大促中,该区域的资源成本降低 30%,且服务稳定性未受影响。

CDN加速弹性扩展机制是应对突发流量尖峰的核心技术支撑,其本质是通过 “实时感知 - 动态调度 - 精准适配 - 持续优化” 的闭环,在 “稳定性、响应速度、成本” 三者之间找到最佳平衡。从电商大促的计划性流量,到赛事直播的区域性流量,再到热点事件的不可预测性流量,CDN弹性扩展已在多场景中验证了其价值,成为互联网业务稳定运行的 “安全阀”。

相关阅读:

CDN加速的节点健康检查与自动修复技术解析

CDN加速:多线路智能切换策略深度剖析

CDN加速的分布式存储原理与性能优化

CDN加速的网络数据迁移技术与加速服务连续性

CDN加速:应对网络拥塞的有效策略